Controle parental no ChatGPT é lançado pela OpenAI

OpenAI lançou hoje (29/09) controle parental no ChatGPT para contas de adolescentes, após críticas e ações judiciais envolvendo riscos à saúde mental. A novidade permite vincular contas de pais e filhos, impor restrições de conteúdo e horários, e receber alertas quando a IA sinalizar conversas sensíveis (ex.: automutilação, ideação suicida).

Em casos de ameaça iminente e se não houver contato com os responsáveis, a empresa diz que poderá acionar autoridades locais. Segundo apuração da revista Wired, os alertas devem chegar em poucas horas e não incluem trechos do chat, preservando algum nível de privacidade do jovem. O recurso começa a ser liberado globalmente hoje e será expandido gradualmente nas próximas semanas.

Tabela de conteúdos

O que é e como funciona o Controle parental no ChatGPT

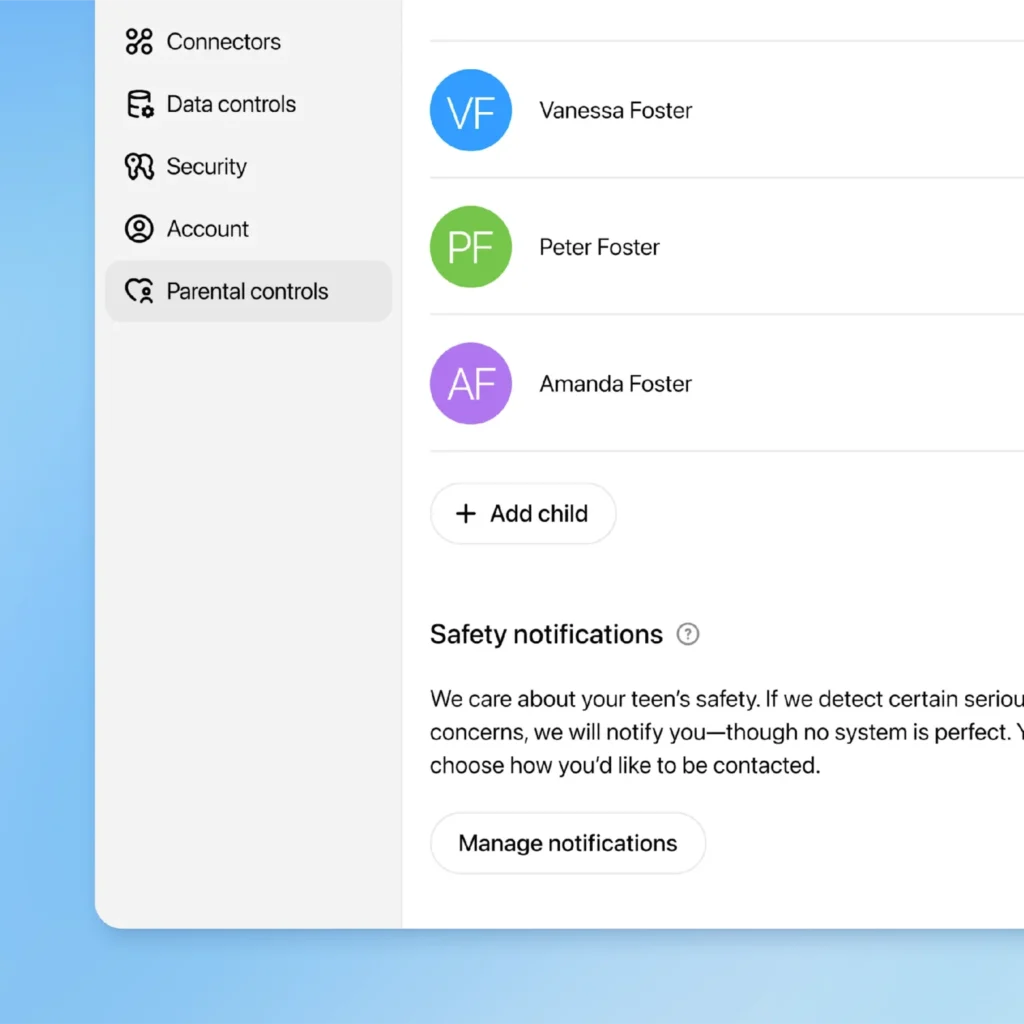

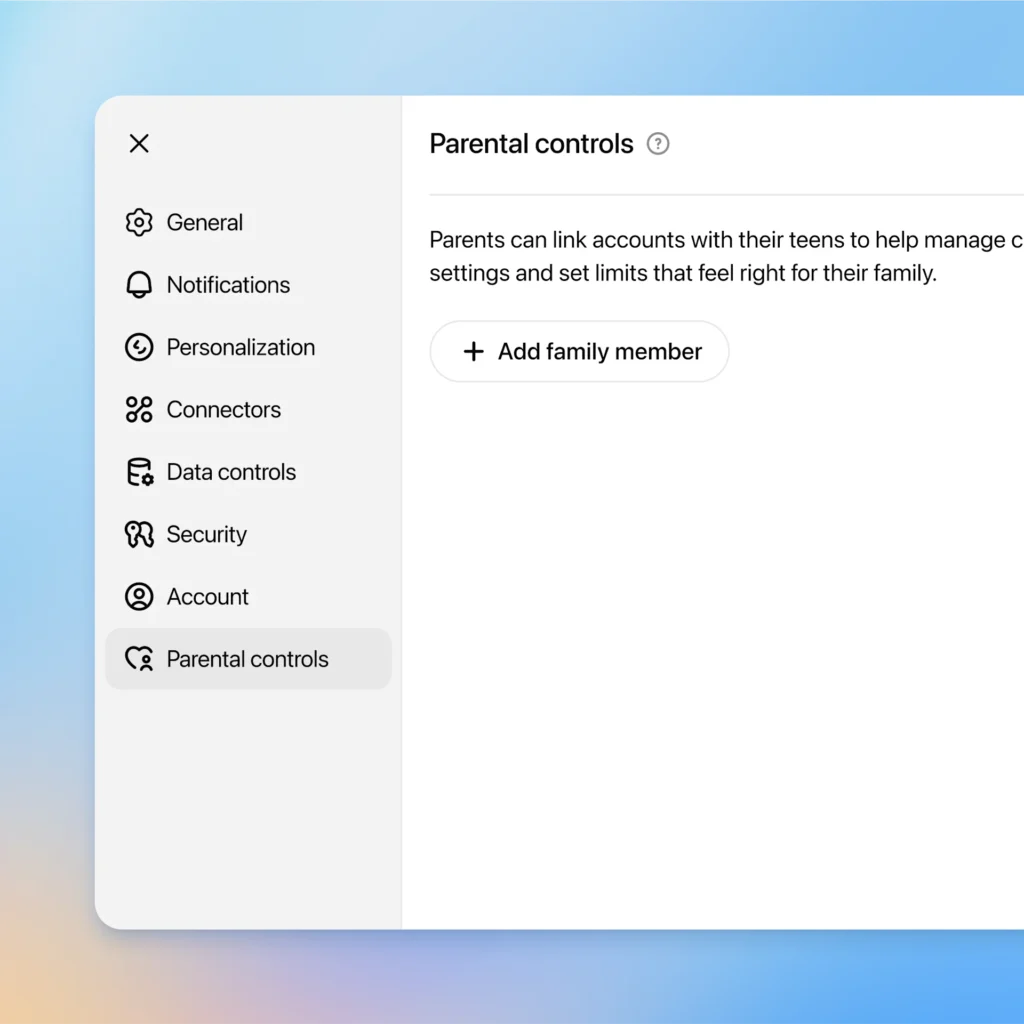

O Controle parental no ChatGPT é um conjunto de configurações que pais e responsáveis podem ativar ao vincular suas contas às de adolescentes. O pareamento exige consentimento mútuo: o responsável envia um convite e o jovem precisa aceitar. Após a conexão, surge a seção “Controle Parental” no menu do ChatGPT, reunindo as preferências de segurança e uso.

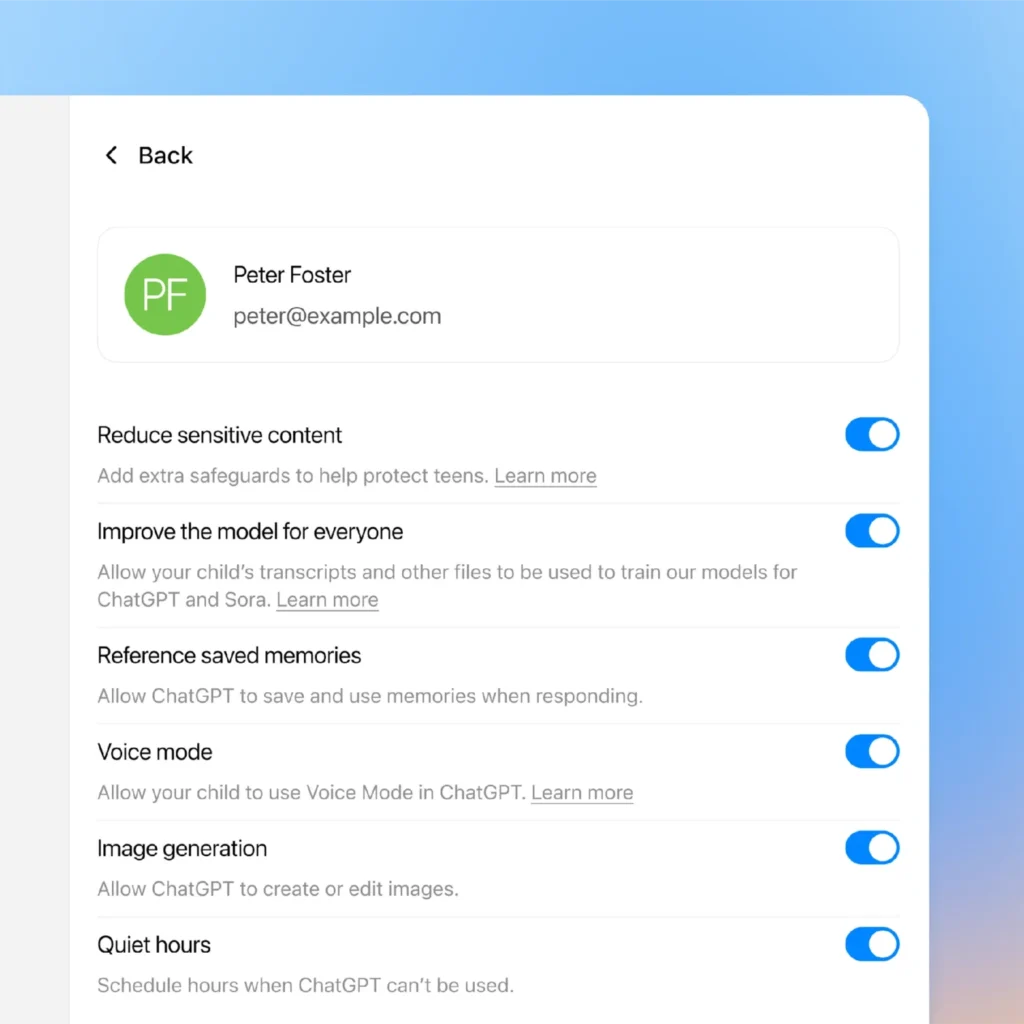

Os principais objetivos são reduzir a exposição a conteúdos potencialmente nocivos, dar visibilidade a sinais de risco e permitir pausas de uso em horários definidos. O pacote inclui proteções padrão para menores, alertas a responsáveis e opções para desativar recursos específicos (voz, geração de imagens e “Memória”).

| Recurso | Como ajuda | Quem controla |

| Vincular contas | Cria painel para gestão e alertas | Pais e adolescente (consentimento) |

| Restrições de conteúdo | Reduz material gráfico, sexual/violento e desafios perigosos | Pais |

| Horários de bloqueio | Limita uso em períodos como aula e madrugada | Pais |

| Alertas de risco | Notifica responsáveis sobre temas sensíveis | OpenAI envia; pais recebem |

| Desativar voz/imagem/memória | Enxuga capacidades que podem ampliar exposição | Pais |

| Opt-out de treinamento | Impede uso das conversas em treino de IA | Pais |

Controle parental no ChatGPT – Alertas aos pais: quando e como acontecem

Quando o sistema detectar termos ou padrões que indiquem risco de automutilação ou suicídio, a OpenAI diz que uma pequena equipe de moderadores humanos revisará o contexto. Se houver sinais de perigo, os responsáveis podem ser notificados por e-mail, SMS ou notificação no app.

De acordo com a Wired, os alertas chegam em questão de horas após a sinalização, mas não mencionam “suicídio” explicitamente nem reproduzem trechos da conversa. A ideia é oferecer informação suficiente para intervenção dos pais sem violar a privacidade do adolescente.

“Os responsáveis receberão orientação prática sobre como abordar o tema e buscar ajuda profissional, preservando a privacidade do jovem.”

Lauren Haber Jonas, chefe de bem-estar juvenil da OpenAI (via Wired)

Em situações de ameaça iminente à vida e se não for possível contatar os responsáveis, a OpenAI declara que poderá acionar autoridades locais. A medida busca cobrir lacunas apontadas em casos recentes que cobravam respostas mais proativas da empresa.

Contexto: críticas, processos e mudança de postura

A OpenAI vinha sendo pressionada após a repercussão do caso de um adolescente de 16 anos cujos pais afirmam que o chatbot teria ajudado a rascunhar uma carta de despedida. A família entrou com processo, alegando omissão e falta de salvaguardas. No início do mês, a empresa anunciou mudanças e, agora, passa a entregá-las.

Além dos alertas, a companhia estuda um sistema de predição de idade — semelhante ao que o YouTube começou a adotar neste ano — para aplicar automaticamente as proteções rígidas a contas que a IA identificar como pertencentes a menores de 18 anos. Detalhes de implementação e precisão não foram divulgados.

O que muda na prática para famílias

- Proteção padrão mais rígida: redução de conteúdo gráfico; bloqueio de roleplay sexual/violento; mitigação de “desafios” perigosos; limitação de ideais de beleza extremos.

- Bloqueios por horário: pais definem janelas sem acesso (ex.: período escolar, madrugada).

- Política de dados: opção para não usar conversas do adolescente em treinamento de modelos.

- Recursos desativáveis: voz, geração de imagens e “Memória”.

- Alertas orientativos: comunicação com recomendações baseadas em especialistas.

Para ativar, os responsáveis devem abrir o ChatGPT, enviar convite de vinculação ao adolescente e, após a aceitação, ajustar as preferências na área “Controle Parental”. A liberação é gradual; algumas opções podem aparecer aos poucos.

Privacidade, limites e perguntas em aberto

Os alertas não trazem trechos de conversa e não citam explicitamente “suicídio”, um desenho que tenta equilibrar privacidade e segurança. Ainda assim, persistem dúvidas relevantes: qual a taxa de falsos positivos? Em quanto tempo médio chegam os avisos? Como a OpenAI documentará auditorias e responderá a solicitações de autoridades? A empresa não detalhou métricas.

Outro ponto sensível é o uso de moderadores humanos. A atuação dessa equipe exige guidelines claras, supervisão e treinamento contínuo para reduzir vieses. E, como em qualquer sistema de risco, a escalabilidade de respostas em horários críticos será determinante para eficácia.

Por fim, a futura predição de idade suscita debates sobre verificação etária, equilíbrio entre usabilidade e proteção, e eventuais erros de classificação. Transparência técnica e relatórios periódicos seriam bem-vindos para fortalecer a confiança pública.

Metodologia, fontes e validação

Este texto se baseia em comunicado da OpenAI e na reportagem da Wired, além de coberturas anteriores sobre o caso que motivou a mudança e o anúncio preliminar dos controles parentais. Quando possível, priorizamos links para fontes primárias e descrevemos limitações conhecidas do sistema.

Como ativar o controle parental no ChatGPT?

Resposta direta: Vincule contas e ajuste a seção ‘Controle Parental’. Expansão: Pais enviam convite no ChatGPT, o adolescente aceita e as preferências ficam acessíveis no menu. É possível definir bloqueios por horário, restrições de conteúdo e desativar recursos (voz, imagens e ‘Memória’). Validação: Recurso liberado gradualmente; detalhes podem variar por região e conta.

O que os alertas enviam aos responsáveis?

Resposta direta: Notificações sobre temas sensíveis, sem trechos do chat. Expansão: Em risco de automutilação/ideação suicida, moderadores revisam e a OpenAI pode alertar em horas por e-mail, SMS ou app. Os avisos não mencionam ‘suicídio’ explicitamente e trazem orientações de especialistas. Validação: Informação confirmada pela Wired e pela OpenAI.

Quais recursos podem ser desativados pelos pais?

Resposta direta: Voz, geração de imagens e ‘Memória’. Expansão: Além das proteções padrão mais rígidas, os pais podem desligar capacidades específicas que ampliem exposição e reduzir a superfície de risco. Validação: Lista informada pela OpenAI no anúncio do pacote de segurança para adolescentes.

É possível impedir que conversas virem treino da IA?

Resposta direta: Sim, há opção de opt-out para contas vinculadas. Expansão: Nas configurações de privacidade, os pais podem recusar o uso das conversas do adolescente para o treinamento dos modelos de IA. Validação: A OpenAI comunicou a disponibilidade desse controle no mesmo pacote.

A OpenAI pode chamar a polícia?

Resposta direta: Somente em ameaça iminente e sem contato com os pais. Expansão: Se moderadores identificarem risco grave à vida e não conseguirem falar com os responsáveis, a OpenAI afirma que poderá acionar autoridades locais. Validação: Posição declarada pela empresa após críticas públicas e casos recentes.

Controle parental no ChatGPT: Considerações finais

O controle parental no ChatGPT responde a uma cobrança legítima por segurança de jovens online, sem prescindir por completo da privacidade. A utilidade dos alertas, porém, depende de tempos de resposta, qualidade das revisões humanas e clareza nos limites do que é sinalizado. Para famílias, a recomendação é ativar os controles, testar cenários e combinar regras de uso com diálogo aberto — tecnologia ajuda, mas não substitui acompanhamento próximo.

Se você ou alguém próximo precisa de ajuda imediata, procure o serviço de saúde de sua região ou ligue para canais de apoio emocional disponíveis no seu país. Em caso de emergência, contate as autoridades locais.