Scale Labs lança o Refactoring Leaderboard no SWE Atlas

A Scale Labs apresentou oficialmente o Refactoring Leaderboard, uma nova iniciativa dentro do SWE Atlas, sua plataforma avançada de avaliação para agentes de codificação baseados em inteligência artificial. O objetivo da novidade é testar até que ponto esses sistemas conseguem atuar como engenheiros de software reais, reestruturando bases de código complexas sem comprometer o comportamento existente das aplicações.

O que é o Refactoring Leaderboard

O novo Refactoring Leaderboard foi criado para avaliar a capacidade dos agentes de IA em lidar com refatorações de código de nível de produção. Ao invés de resolver pequenos desafios de programação isolados, o benchmark examina a habilidade dos modelos em compreender arquiteturas extensas, editar múltiplos arquivos e manter a integridade dos testes automatizados após uma modificação estrutural.

De acordo com os dados da própria Scale Labs, as tarefas do SWE Atlas Refactoring exigem quase o dobro de linhas de código alteradas e 1,7 vezes mais edições de arquivos quando comparadas aos desafios do SWE-Bench Pro. Isso transforma o benchmark em um verdadeiro teste de desempenho para sistemas de IA que afirmam ter competências de engenharia de software.

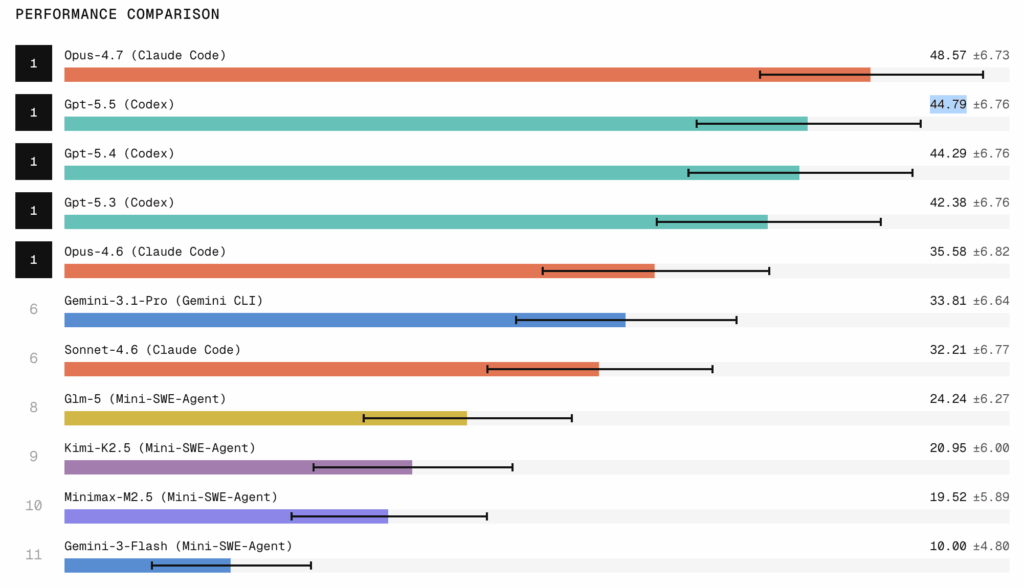

Principais resultados e modelos em destaque

O modelo Claude Code com Opus 4.7 liderou o ranking do Refactoring Leaderboard, com o estudo mostrando que ele entrega as refatorações mais robustas entre todos os agentes avaliados. Na segunda posição aparece o ChatGPT 5.5, evidenciando uma competitividade crescente entre os modelos fechados de ponta.

O levantamento ainda deixa clara a diferença entre as IAs de código aberto e os sistemas fechados de grandes corporações. Modelos open source ficaram para trás em desafios que demandam exploração de repositórios, reorganização estrutural e manutenção de comportamento funcional, tarefas essenciais em cenários de engenharia real.

- Decomposição de implementações monolíticas

- Substituição de interfaces fracas por abstrações tipadas

- Extração de lógica duplicada para módulos compartilhados

- Realocação de código para aprimorar fronteiras de módulos

Cada tarefa tem avaliação baseada tanto na passagem de testes quanto em uma revisão de critérios técnicos, incluindo manutenibilidade, limpeza de artefatos, redução de antipadrões e clareza documental. Essa análise multifatorial mostra se o agente realmente entrega código de qualidade de engenharia.

O problema da confiabilidade

Um dos resultados mais relevantes do estudo é que, embora os modelos consigam frequentemente fazer um refactor que passa nos testes, eles ainda falham em critérios de qualidade humana. Muitos agentes deixam rastros de código morto, imports obsoletos, duplicações e comentários desatualizados — falhas que, em um ambiente de produção, se traduziriam em baixa manutenibilidade.

Segundo a Scale Labs, quando os modelos tentam a mesma tarefa três vezes, têm de duas a três vezes mais chance de acertar uma execução do que de acertar todas. Isso demonstra que a consistência — e não apenas a capacidade pontual — continua sendo o maior desafio para que agentes de IA possam operar com autonomia em pipelines de desenvolvimento reais.

“A confiabilidade é o principal obstáculo para os agentes de IA”, enfatizou Jason Droege, CEO da Scale Labs. “O Refactoring Leaderboard evidencia que o desempenho máximo e a consistência ainda evoluem em ritmos diferentes.”

Jason Droege, CEO da Scale Labs

Droege complementa que, embora os modelos mais fortes estejam evoluindo continuamente, eles ainda precisam melhorar significativamente em repetibilidade, limpeza de artefatos e compreensão profunda de bases de código antes de conquistarem autonomia operacional.

O papel do SWE Atlas na engenharia assistida por IA

O SWE Atlas é uma estrutura de pesquisa que posiciona os agentes de IA próximos de verdadeiros engenheiros de software. Ele testa habilidades como inspeção de código, inferência de restrições de design, edição coordenada e prevenção de regressões. O Refactoring Leaderboard representa o fechamento do ciclo dessa suíte, focando na parte mais delicada da automação: mudar a estrutura sem alterar o comportamento do sistema.

Essa abordagem reforça o movimento crescente de mercado em torno da engenharia assistida por IA, em que empresas como Anthropic, OpenAI, Google e Microsoft competem para criar assistentes capazes de lidar com projetos de larga escala e compreensão contextual de repositórios complexos.

Impacto na indústria e próximos passos

Com benchmarks cada vez mais exigentes como o Refactoring Leaderboard, a indústria avança para uma nova fase de avaliação técnica — uma que busca realismo e confiabilidade de engenharia, e não apenas desempenho em pequenos testes de código. A longo prazo, isso poderá definir novos padrões para o uso de IA em fluxos de desenvolvimento de software corporativos e projetos open source.

De acordo com a Scale Labs, a meta é continuar expandindo o SWE Atlas para incluir novos tipos de tarefas que envolvam design, integração contínua e resolução de bugs em pipelines completos. Assim, os agentes de IA não apenas escreverão código, mas compreenderão o ciclo de vida completo do software.

Perguntas Frequentes

O que é o Refactoring Leaderboard?

O Refactoring Leaderboard é uma métrica criada pela Scale Labs para medir a capacidade de agentes de IA em refatorar bases de código grandes e reais, preservando o comportamento funcional e mantendo boas práticas de engenharia.

Qual modelo lidera o ranking?

O modelo Claude Code com Opus 4.7 ocupa o primeiro lugar no Refactoring Leaderboard, seguido pelo ChatGPT 5.5, ambos superando outros agentes em consistência e qualidade de refatoração.

Por que confiabilidade é importante na refatoração com IA?

Mesmo que um modelo produza uma refatoração que passe nos testes, ele precisa garantir consistência e limpeza de código em execuções repetidas. A confiabilidade é essencial para uso em ambientes de produção.

Como o SWE Atlas se diferencia de outros benchmarks?

O SWE Atlas não testa apenas tarefas isoladas de código. Ele avalia comportamento em projetos completos, simula fluxos de engenharia e mede habilidades críticas como manutenção e reuso.

Considerações finais

O lançamento do Refactoring Leaderboard marca uma etapa importante na evolução das ferramentas de avaliação de agentes de IA. Com foco em confiabilidade e qualidade técnica, a Scale Labs reforça seu papel de liderança na fronteira entre pesquisa acadêmica e prática de engenharia de software assistida por inteligência artificial. Resta agora acompanhar como essas métricas influenciarão o desenvolvimento dos próximos modelos — e se, em breve, veremos agentes realmente capazes de refatorar sistemas com o mesmo rigor de um engenheiro humano.