Anthropic lança Code Review para revisar código gerado por IA

A Anthropic revelou uma nova ferramenta chamada Code Review, projetada para lidar com o crescente volume de código gerado por inteligência artificial. O lançamento, anunciado em 9 de março de 2026, marca uma expansão significativa da suíte Claude Code, voltada para empresas que dependem de automação em larga escala para desenvolvimento de software.

Tabela de conteúdos

O desafio do código gerado por IA

Com o avanço das ferramentas de vibe coding — expressão usada para descrever a criação de código com instruções em linguagem natural — o número de linhas de código geradas por IA cresceu exponencialmente. Embora isso acelere o desenvolvimento, também traz riscos, incluindo bugs ocultos e falhas de segurança. O Code Review surge como resposta a esse fenômeno.

Segundo Cat Wu, diretora de produto da Anthropic, a função principal da nova ferramenta é revisar automaticamente os códigos produzidos com o Claude Code antes que sejam incorporados ao repositório principal de projetos empresariais. Wu explicou que muitas empresas enfrentam gargalos na aprovação de pull requests devido ao alto volume de alterações enviadas pelas IAs, e a ferramenta visa reduzir esses entraves.

Como funciona o Code Review da Anthropic

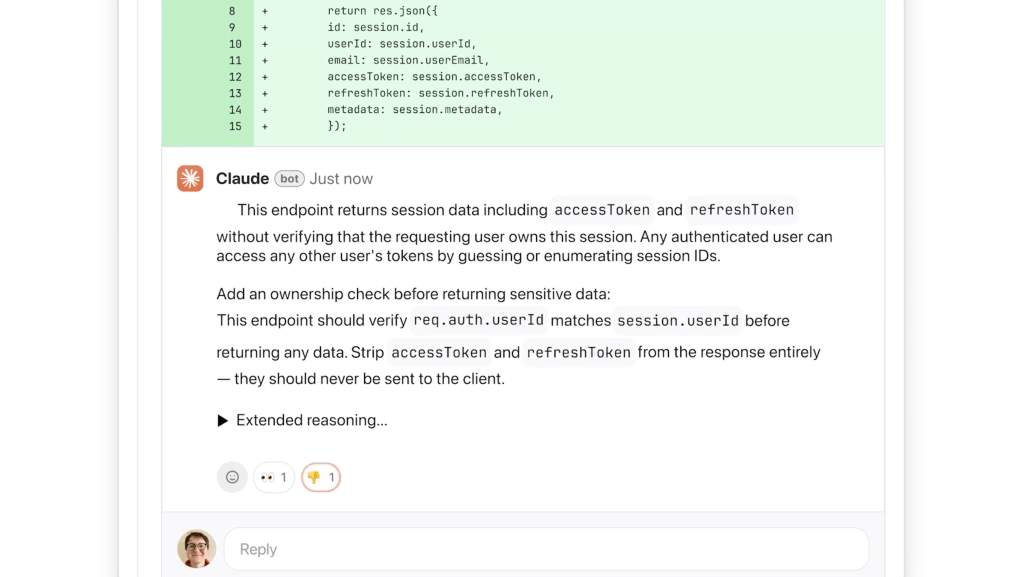

O Code Review está disponível em modo de prévia de pesquisa para clientes das versões Claude for Teams e Claude for Enterprise. Seu funcionamento combina múltiplos agentes de IA operando em paralelo, cada um responsável por examinar o código sob diferentes perspectivas — desde análise lógica até vulnerabilidades potenciais. Um agente mestre agrega os resultados, eliminando redundâncias e classificando as falhas por prioridade.

A ferramenta se integra diretamente ao GitHub e realiza comentários automáticos nas solicitações de revisão. Os alertas são organizados por cores: vermelho indica falhas críticas, amarelo aponta problemas potenciais e roxo refere-se a bugs históricos ou de código legado. O foco inicial é identificar erros lógicos, deixando ajustes de estilo para desenvolvedores humanos.

“Muitos desenvolvedores já viram feedbacks automáticos de IA que não são acionáveis”, comentou Cat Wu. “Decidimos mirar exclusivamente em erros de lógica. Assim, garantimos eficiência e melhoria real na qualidade do código.”

Cat Wu, diretora de produto da Anthropic

Integração com segurança e personalização

Além da detecção de bugs, o sistema realiza uma análise leve de segurança. Líderes de engenharia podem ajustar parâmetros para incluir verificações personalizadas, adaptadas às práticas internas das empresas. Para uma verificação mais profunda, a Anthropic oferece o módulo complementar Claude Code Security, lançado algumas semanas antes.

O modelo de cobrança é baseado no uso, variando de acordo com a complexidade do código. Wu estima que cada revisão custará entre US$ 15 e US$ 25 em média, refletindo o caráter premium da solução — uma ferramenta essencial para um cenário onde a geração de código por IA continua a crescer rapidamente.

Conexão com o cenário corporativo do Code Review da Anthropic

No momento do lançamento, a Anthropic enfrenta um contexto corporativo e político intenso. A empresa entrou com dois processos contra o Departamento de Defesa dos Estados Unidos, contestando sua designação como “risco de cadeia de suprimentos”. Mesmo em meio a disputas judiciais, a companhia registrou crescimento acelerado nas assinaturas empresariais do Claude Code, com receita recorrente superior a US$ 2,5 bilhões desde o lançamento do produto.

Empresas como Uber, Salesforce e Accenture já integram o Claude Code em seus fluxos de trabalho, e são também o público-alvo da nova ferramenta. Gestores podem ativar o Code Review como uma camada automática de validação, assegurando que cada nova função aprovada passe por um rigoroso escrutínio lógico antes da integração ao código mestre.

Tecnologia multiagente e explicabilidade

O diferencial técnico mais relevante do Code Review está em sua arquitetura de IA multiagente. Cada agente atua como um “especialista virtual”, examinando dimensões específicas — estrutura, coerência e dependências. Em seguida, o agente principal gera um relatório detalhado que inclui não apenas as falhas detectadas, mas também o raciocínio por trás de cada alerta e sugestões de correção passo a passo.

Essa abordagem de explicabilidade vem se tornando um padrão em soluções de IA voltadas ao desenvolvimento de software, garantindo que as equipes de engenharia possam compreender o porquê das recomendações feitas pelos modelos. Isso contribui para a confiança no uso de IA em pipelines críticos de código corporativo.

Code Review e o futuro da engenharia assistida por IA

Para a Anthropic, o lançamento reflete uma tendência inevitável: empresas estão delegando partes cada vez maiores de suas operações de desenvolvimento à inteligência artificial. À medida que o Claude Code reduz o esforço manual de engenharia, aumenta a demanda por soluções automatizadas de verificação — daí o interesse crescente pelo novo sistema.

Cat Wu destaca que a aceitação da ferramenta foi impulsionada por “uma enorme tração de mercado”: “Com o Code Review, esperamos que as empresas consigam desenvolver mais rápido do que nunca e com menos bugs do que jamais tiveram.”

Perguntas Frequentes sobre o Code Review da Anthropic

O que é o Anthropic Code Review?

O Code Review é uma ferramenta de IA desenvolvida pela Anthropic para revisar automaticamente códigos gerados por inteligência artificial no ambiente do Claude Code. Ela identifica erros lógicos e potenciais falhas antes que o código seja implementado nos sistemas corporativos.

Como o Code Review detecta erros de lógica?

O sistema utiliza uma arquitetura multiagente: diferentes modelos examinam o código sob perspectivas complementares e um agente principal consolida as análises, classificando os problemas em níveis de severidade e sugerindo correções detalhadas.

Empresas podem personalizar as verificações do Code Review?

Sim. Líderes técnicos podem configurar verificações adicionais conforme práticas internas e integrar o Code Review com outras ferramentas de segurança, como o módulo Claude Code Security.

Quanto custa usar o Code Review?

O preço é calculado com base na complexidade do código e na quantidade de tokens processados. Segundo a Anthropic, cada revisão custa entre US$ 15 e US$ 25 em média.

Quando o Code Review estará amplamente disponível?

Atualmente em fase de pesquisa para clientes empresariais, a Anthropic planeja expandir o acesso ao Code Review ao longo de 2026 para todos os usuários do Claude Code for Enterprise.

Considerações finais

O lançamento do Code Review da Anthropic representa um marco na evolução da engenharia assistida por IA. Ao unir automação inteligente, verificações explicáveis e integração nativa ao fluxo de trabalho de desenvolvedores, a ferramenta promete redefinir os padrões de qualidade no código corporativo em um momento em que o ritmo de desenvolvimento impulsionado por IA é mais veloz do que nunca.