Anthropic treinará IA com conversas; decida até 28/9

A Anthropic exigirá que usuários do Claude escolham até 28 de setembro de 2025 se permitem usar suas conversas para treinar a IA. O que muda: dados de chats e sessões de código poderão alimentar modelos futuros, e a retenção passa a ser de até 5 anos para quem não optar por sair. Antes, os registros eram apagados em até 30 dias (salvo exigência legal/política ou violações, guardadas por até 2 anos).

A nova política cobre Claude Free, Pro e Max, incluindo o Claude Code; já clientes empresariais (Claude Gov, for Work, for Education e API) não são afetados. A escolha aparece no cadastro para novos usuários e, para contas existentes, em um pop-up com botão “Aceitar” e um seletor menor para o treinamento — ativado por padrão.

Tabela de conteúdos

O que exatamente mudou

Até aqui, a Anthropic afirmava que prompts e respostas dos produtos de consumo eram apagados automaticamente após 30 dias, com exceções: exigências legais/políticas ou conteúdos marcados como violação, que poderiam ser retidos por até 2 anos. Com a atualização, conversas e sessões de programação passam a poder treinar modelos futuros e a retenção se estende para até 5 anos para quem não fizer opt-out. Em termos práticos, a empresa busca consolidar um corpus amplo de interações reais para melhorar segurança, capacidade de raciocínio e desempenho em tarefas de análise e código.

Quem é afetado (e quem está fora)

As mudanças se aplicam aos usuários de consumo: Claude Free, Claude Pro e Claude Max — e também ao Claude Code. Não valem para clientes empresariais e institucionais que usam Claude Gov, Claude for Work, Claude for Education ou acesso via API, que permanecem isentos de uso de dados para treinamento por padrão. Esse recorte segue uma prática já vista no setor, em que planos corporativos oferecem garantias específicas de privacidade e zero data retention.

- Consumidor (afetado): Claude Free, Pro, Max e Claude Code

- Empresarial (não afetado): Gov, for Work, for Education e API

- Decisão: optar por sair até 28/09 para bloquear uso em treinamento

Por que agora? Dados, concorrência e contexto regulatório

Modelos de linguagem precisam de volumes crescentes de dados de alta qualidade — especialmente diálogos reais e códigos. Ao abrir a porta para treinar com interações do Claude, a Anthropic se alinha ao movimento competitivo do setor contra OpenAI e Google.

Ao mesmo tempo, há uma maré regulatória e jurídica em curso: a OpenAI, por exemplo, divulgou que enfrenta uma ordem judicial que a obriga a reter conversas de consumidores do ChatGPT por tempo indeterminado, inclusive chats apagados, no âmbito de ações movidas pelo The New York Times e outros veículos.

Em junho, o COO da OpenAI, Brad Lightcap, classificou essas exigências como “abrangentes e desnecessárias”, em resposta pública. Mesmo que o caso seja distinto, a pressão por retenções mais longas e políticas mais explícitas atinge toda a indústria de IA.

“Ao não optar por sair, você nos ajuda a melhorar a segurança dos modelos, reduzindo falsos positivos e elevando habilidades como código, análise e raciocínio.”

Anthropic, atualização de termos

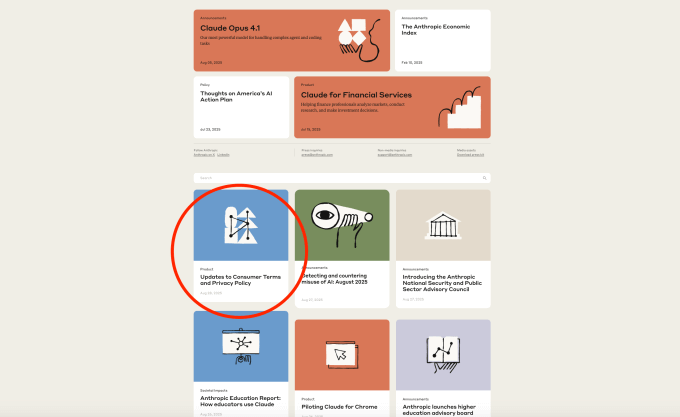

Opt-out na prática e o debate sobre design

Novos usuários escolhem a preferência no cadastro. Já quem usa o serviço verá um pop-up “Updates to Consumer Terms and Policies” com um botão “Accept” bem visível e, abaixo, um seletor menor para permissão de treinamento — ativado por padrão. Como observou o The Verge, esse arranjo pode levar muita gente a clicar em “aceitar” sem perceber que está autorizando o uso de dados. O desenho da interface, portanto, entra no centro do debate sobre consentimento informado e padrões escuros de UX.

Vale reforçar: é possível optar por sair, mas é preciso localizar o seletor (toggle) e desativá-lo antes de confirmar. A Anthropic também aponta que, mesmo para quem faz opt-out, certos dados podem ser retidos por motivos de segurança, prevenção de abusos ou cumprimento legal, conforme políticas vigentes.

Privacidade, consentimento e fiscalização

Especialistas em privacidade alertam que a complexidade da IA torna o consentimento significativo um objetivo difícil. Órgãos como a Federal Trade Commission (FTC) já advertiram empresas de IA a respeitar compromissos de confidencialidade e a não “enterrar” mudanças importantes em links, jargões ou letras miúdas. A agência escreveu publicamente sobre o tema no início de 2024 (leia o aviso). Se a fiscalização seguirá no mesmo ritmo hoje é uma questão em aberto; inclusive, a própria composição da FTC mudou recentemente, operando com apenas três dos cinco comissários.

Como se proteger: passos imediatos

- Revise o pop-up e desative o toggle de “treinamento de dados”.

- Abra as configurações da conta e confirme o opt-out.

- Evite inserir dados sensíveis em qualquer chat de IA.

- Para garantias adicionais, considere planos corporativos com ZDR (zero data retention).

- Estabeleça políticas internas sobre uso de IA em times e escolas.

Antes e depois: o que muda na retenção

| Aspecto | Antes | Agora |

| Uso para treinamento | Não (produtos de consumo) | Sim, salvo opt-out |

| Retenção padrão | Até 30 dias | Até 5 anos |

| Exceções | Exigência legal/política; violações (até 2 anos) | Exigência legal/política; segurança/abuso |

| Quem é afetado | — | Claude Free, Pro, Max e Code |

| Quem está fora | — | Gov, Work, Education, API |

Validação e fontes

As informações deste texto se baseiam no comunicado oficial da Anthropic (atualização de termos) e em reportagens setoriais, como a análise do The Verge sobre o design do pop-up de consentimento. O pano de fundo jurídico foi complementado pela nota pública da OpenAI a respeito da ordem judicial de retenção de conversas e pelo aviso da FTC sobre mudanças discretas de políticas de privacidade.

“Exigir que as pessoas naveguem por letras miúdas ou links para achar mudanças relevantes pode minar o consentimento informado.”

FTC, orientação sobre IA e privacidade

Como faço opt-out do treinamento de dados?

Resposta direta: desative o toggle de treinamento antes de aceitar. — Expansão: no pop-up de “Updates to Consumer Terms”, localize o seletor (ativado por padrão), desligue-o e só então confirme. Depois, valide em Configurações da conta para garantir que a preferência foi salva. — Validação: instruções baseadas no aviso em produto e na atualização oficial da Anthropic (link no artigo).

Quais planos do Claude são afetados?

Resposta direta: Free, Pro, Max e Claude Code. — Expansão: os produtos de consumo passam a permitir o uso de conversas e sessões de código para treinar modelos, salvo opt-out explícito. — Validação: a própria Anthropic especifica que Gov, for Work, for Education e API não são afetados por essa política de treinamento.

Por quanto tempo meus dados podem ser retidos?

Resposta direta: até 5 anos, se você não optar por sair. — Expansão: a retenção padrão sobe de 30 dias para até 5 anos em contas de consumo; exceções legais e de segurança podem se aplicar mesmo com opt-out. — Validação: comparação com a política anterior e as novas diretrizes publicadas pela Anthropic.

Minhas conversas apagadas continuam armazenadas?

Resposta direta: depende da política e de exigências legais. — Expansão: empresas podem reter registros por segurança, prevenção de abuso ou ordens legais; o botão “apagar” pode não eliminar tudo de imediato. — Validação: o setor discute retenção e ordens judiciais; a OpenAI citou pedido judicial para guardar conversas (link no artigo).

Sou empresa: meus dados serão usados para treinar?

Resposta direta: não, em planos enterprise e API. — Expansão: clientes Gov, for Work, for Education e API permanecem com proteções específicas, incluindo zero data retention em acordos dedicados. — Validação: a Anthropic diferencia claramente produtos de consumo e corporativos em sua documentação.

Considerações finais

A decisão da Anthropic alinha a empresa à realidade de modelos famintos por dados e acirra a disputa por qualidade de treinamento. Para usuários, o recado é claro: leia o pop-up, ajuste o seletor e defina sua preferência antes do prazo. Para equipes e escolas, vale consolidar políticas internas e, quando necessário, migrar para planos com garantias de retenção zero. O debate público sobre consentimento e transparência seguirá intenso — e, até lá, a melhor defesa é informação, atenção aos detalhes e disciplina no que compartilhamos com qualquer sistema de IA.