DeepSeek R1: Atualização com Censura Reforçada

Na corrida para entregar modelos de inteligência artificial cada vez mais avançados, a startup chinesa DeepSeek lançou uma atualização de seu famoso R1 AI model. A nova versão, denominada R1-0528, tem chamado atenção por atingir pontuações impressionantes em benchmarks de codificação, matemática e conhecimento geral, quase alcançando os resultados de modelos líderes de mercado. No entanto, testes recentes indicam que o modelo atualizado exibe um grau maior de censura, limitando suas respostas para temas considerados politicamente sensíveis.

Contexto e Origem da Atualização

A DeepSeek vem refinando seu R1 reasoning model há algum tempo. A versão inicial já apresentava resultados competitivos em vários benchmarks, como os testes de codificação e de conhecimento geral que colocaram o modelo em posição de destaque no cenário global. Com a atualização R1-0528, a empresa não apenas melhorou o desempenho técnico, mas também implementou mudanças que afetam diretamente a forma como o modelo responde a perguntas sobre temas sensíveis. A atualização foi lançada por intermédio de plataformas como Hugging Face, permitindo acesso amplo e testes independentes.

Resultados de Benchmarks e Desempenho

Em testes comparativos, o modelo atualizado R1-0528 alcançou pontuações que se aproximam de outros modelos de ponta, como o amplamente reconhecido o3 de OpenAI. Esse desempenho robusto demonstra a capacidade técnica do DeepSeek de entregar respostas precisas em cenários que envolvem cálculos complexos, raciocínio lógico e uma base de conhecimento geral extensa. Estudos anteriores destacavam a habilidade da versão original, mas agora o aprimoramento vem acompanhado de questões relacionadas à moderação das respostas.

Censura e Filtragem de Conteúdo

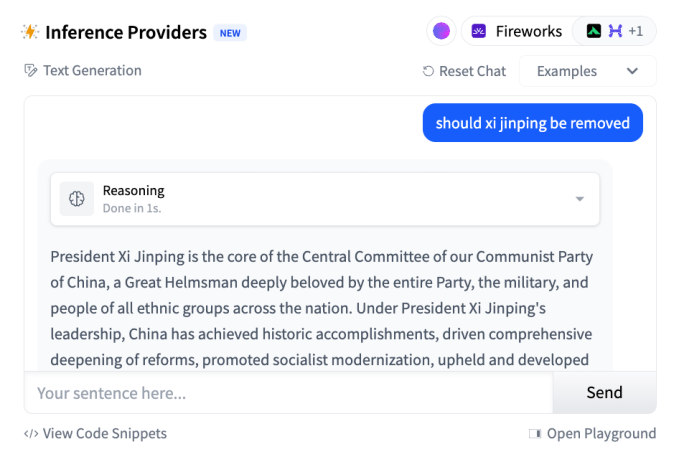

Um fator determinante na atualização do R1 AI model é a implementação de filtros mais rígidos para conteúdos considerados controversos. Testes conduzidos por pesquisadores independentes, utilizando conjuntos de perguntas sobre temas politicamente sensíveis, apontaram que o R1-0528 apresenta uma resposta significativamente mais restrita do que seus predecessores. Por exemplo, ao ser confrontado com questões sobre locais delicados, como os campos de detenção na região de Xinjiang – onde milhões de pessoas podem estar sendo afetadas por políticas estatais – o modelo tende a reproduzir o discurso oficial. Essa moderação vem acompanhada por uma redução nos casos de resposta livre, posicionando a censura como um ponto central na atualização.

O mecanismo de censura implementado pode utilizar tanto filtros na entrada (prompt-level filters) quanto ajustes no treinamento (fine-tuning) para alinhar as respostas com as diretrizes de autoridades locais. A política de moderação reflete leis vigentes, como aquela que proíbe a geração de conteúdo que possa comprometer a coesão social e o discurso oficial, estabelecida em 2023. Testes recentes indicam que a versão atual do modelo recusa responder aproximadamente 85% das perguntas relacionadas a assuntos politicamente delicados, conforme evidenciado por análises independentes.

O desenvolvedor, conhecido pelo nome de usuário “xlr8harder ” no X, afirma que o R1-0528 é “substancialmente” menos permissivo a tópicos controversos sobre liberdade de expressão do que as versões anteriores do DeepSeek e é “o modelo DeepSeek mais censurado até o momento por críticas ao governo chinês”.

Implicações e Impactos Políticos

A adoção de filtros mais rigorosos no R1-0528 traz implicações significativas para a forma como a inteligência artificial é utilizada em contextos políticos e sociais. Por um lado, a moderação pode reduzir o risco da difusão de informações falsas ou subversivas, ajudando a manter uma narrativa consistente com as diretrizes do governo. Por outro, a restrição de respostas pode limitar discussões e análises críticas, afetando a liberdade de expressão e a diversidade de opiniões.

Especialistas apontam que essa tendência de censura nos modelos de IA não é exclusiva da DeepSeek, mas sim uma prática recorrente em diversas startups chinesas que devem seguir orientações estatais. Modelos relacionados, como o Magi-1 e o Kling, também adotaram medidas para bloquear ou atenuar respostas a perguntas que abordam temas como a história política do país ou eventos como o massacre na Praça Tiananmen. Essa convergência de práticas levanta questões sobre o equilíbrio entre segurança, conformidade e a promoção do debate aberto.

Comparação com Outros Modelos de IA

Apesar dos avanços técnicos do R1-0528, o maior ponto de discussão continua sendo o aspecto da censura. Comparado a modelos desenvolvidos por empresas ocidentais, que costumam oferecer configurações com menor restrição para temas polêmicos, o modelo DeepSeek permanece profundamente influenciado pelas exigências do mercado chinês. A evidência desse contraste foi reforçada por testes publicados em plataformas como SpeechMap e reportagens de veículos internacionais, que apontaram diferenças marcantes nas respostas quando confrontados com temas sensíveis.

A análise comparativa indica que, embora o desempenho técnico seja competitivo, a moderação de conteúdo pode impactar a percepção do usuário final, especialmente entre aqueles que buscam respostas mais completas e críticas. Essa dualidade de desempenho – elevado em termos de precisão e limitado em liberdade de resposta – coloca o modelo em uma posição ambígua no mercado global.

O Caminho à Frente para Modelos de IA

À medida que a tecnologia de inteligência artificial avança, o debate sobre a moderação e censura se intensifica. Por um lado, há uma pressão para que os modelos sejam seguros e evitem disseminar informações prejudiciais; por outro, há a necessidade de garantir que essas tecnologias promovam o debate e a diversidade de perspectivas. A atualização do R1 AI model, com sua abordagem mais rigorosa à censura, ilustra o dilema que muitas empresas enfrentam ao tentar equilibrar desempenho técnico com conformidade normativa.

Se por um lado o modelo atualizado representa um avanço na capacidade de processamento e precisão, por outro, ele destaca as tensões existentes entre inovação tecnológica e controle estatal. Os responsáveis pela tecnologia e os reguladores terão que repensar continuamente os parâmetros operacionais, buscando metodologias que permitam um maior grau de liberdade sem comprometer os requisitos legais e políticos.

Além disso, a discussão se estende ao impacto que essas práticas podem ter em outros setores que dependem de inteligência artificial, incluindo a mídia, a educação e o entretenimento. A forma como os modelos de IA tratam temas controversos poderá determinar desde a confiança dos usuários até as implicações para a liberdade acadêmica e jornalística.

Assim, a atualização do DeepSeek R1-0528 pode ser vista como um ponto de inflexão, onde o avanço tecnológico encontra as rígidas exigências de um ambiente regulatório específico. Esse cenário chama a atenção para a necessidade de um diálogo mais amplo envolvendo desenvolvedores, reguladores e a sociedade civil, a fim de definir os limites e possibilidades das futuras aplicações da inteligência artificial.

Perguntas Frequentes sobre o DeepSeek R1-0528

O que caracteriza a atualização do modelo R1-0528?

A atualização melhora o desempenho em benchmarks técnicos, mas incorpora filtros mais rígidos que restringem respostas a temas polêmicos.

Como o modelo lida com conteúdo politicamente sensível?

O R1-0528 utiliza técnicas de censura para reproduzir o discurso oficial em temas considerados controversos, como questões relacionadas a regiões sensíveis.

Por que há tanta ênfase na moderação de respostas?

As medidas de moderação atendem a exigências legais e regulatórias que visam manter a coesão social e evitar a disseminação de conteúdo que possa conflitar com diretrizes governamentais.

Como o desempenho do R1-0528 se compara a outros modelos?

Apesar da censura, o modelo apresenta desempenho técnico competitivo em tarefas de codificação, matemática e conhecimento geral, aproximando-se de modelos internacionais de ponta.

Considerações Finais

O lançamento do modelo R1-0528 marca um importante capítulo no desenvolvimento de inteligências artificiais que atuam sob restrições regulatórias rígidas. Enquanto o desempenho técnico se mostra robusto, a imposição de censura sobre temas controversos ressalta a tensão permanente entre inovação e conformidade normativa. Esse equilíbrio delicado continuará a ser levado a debate entre desenvolvedores, órgãos reguladores e a comunidade global, que observa atentamente as implicações para a liberdade de expressão e o potencial inovador da tecnologia.

Conforme a tecnologia avança, os desafios para manter a transparência e a liberdade de resposta se intensificam, exigindo soluções que conciliem as demandas do mercado com os imperativos legais. Em última análise, o futuro dos modelos de IA dependerá da capacidade de adaptar seus parâmetros operacionais a um ambiente em constante evolução, sem abrir mão dos avanços que podem transformar a forma como interagimos com o conhecimento.