Gemini Embedding 2: o modelo multimodal da Google

O Google DeepMind anunciou a chegada do Gemini Embedding 2, o primeiro modelo de incorporação (embedding) nativamente multimodal da empresa. Disponível em versão pública via Gemini API e Vertex AI, a novidade promete transformar a forma como sistemas de inteligência artificial interpretam e relacionam diferentes tipos de dados — de texto e imagens a vídeos, áudios e documentos — dentro de um único espaço semântico compartilhado.

Tabela de conteúdos

Entendendo o conceito de embeddings multimodais

Embeddings são representações matemáticas que transformam informações em vetores numéricos. Esses vetores permitem aos sistemas de IA medir semelhanças semânticas entre conteúdos. No caso do Gemini Embedding 2, a novidade está em permitir que essa representação unificada inclua, simultaneamente, textos, imagens, vídeos, sons e arquivos — algo inédito em larga escala dentro dos modelos da Google.

Essa capacidade é essencial para aplicações de busca semântica, recomendação multimodal e Geração Aumentada por Recuperação (RAG). Ao integrar diferentes mídias, o modelo pode compreender, por exemplo, o contexto de uma imagem com legenda, correlacionar um vídeo com seu áudio correspondente ou comparar trechos de um documento PDF com perguntas em linguagem natural.

Recursos e suporte multimodal avançado

- Texto: até 8192 tokens de entrada por requisição.

- Imagens: até seis imagens por requisição, nos formatos JPEG e PNG.

- Vídeos: suporte para até 120 segundos em arquivos MP4 e MOV.

- Áudio: processamento nativo sem transcrição intermediária.

- Documentos: PDFs de até seis páginas incorporadas diretamente.

Essa arquitetura integrada permite enviar entradas intercaladas — como texto e imagem no mesmo pedido —, o que ajuda o modelo a capturar as relações sutis entre modalidades diferentes. A funcionalidade é útil em sistemas de recomendação, análise de sentimentos visuais e classificação multimodal.

O papel do Matryoshka Representation Learning

Assim como nos modelos anteriores, a Google manteve no Gemini Embedding 2 a técnica Matryoshka Representation Learning (MRL), que organiza as representações de forma hierárquica. Essa abordagem permite ajustar a dimensionalidade de saída conforme a necessidade do projeto — de 3072 até 768 dimensões — equilibrando desempenho e custo de armazenamento.

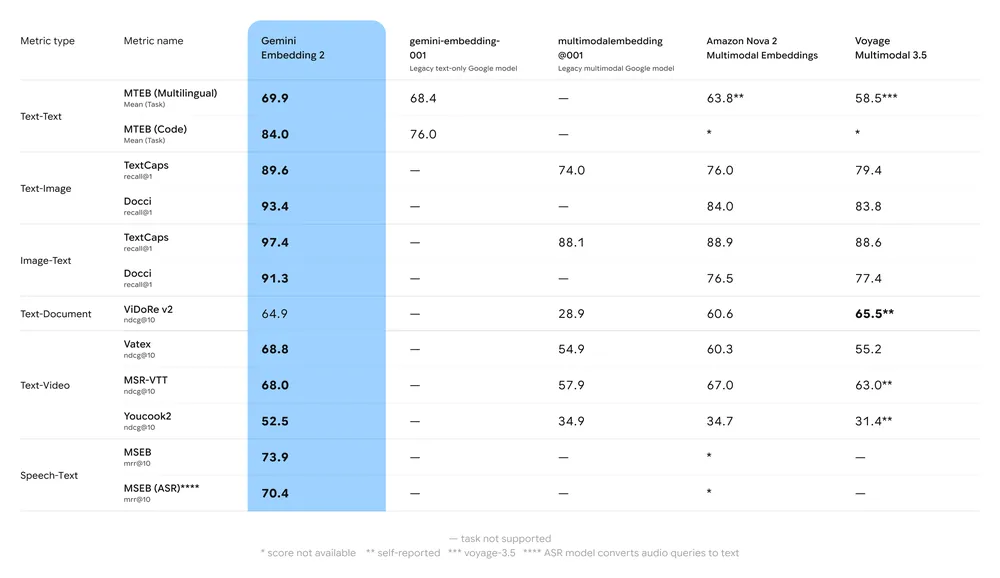

Desempenho de última geração

Com base na arquitetura Gemini, o novo sistema já supera modelos legados em tarefas de linguagem, visão e até áudio. O desempenho elevado reflete na qualidade de incorporação para pesquisa semântica, classificação multimodal e análise contextual — ampliando as oportunidades para desenvolvedores, pesquisadores e empresas que trabalham com grandes volumes de dados diversificados.

Aplicações práticas e integração com ferramentas

O Gemini Embedding 2 já pode ser integrado a diversos ecossistemas e frameworks de IA conhecidos. Entre os compatíveis estão o LangChain, LlamaIndex, Haystack, Weaviate, QDrant e ChromaDB. Além dessas opções open-source, a Google também oferece integração direta com o Vector Search no Vertex AI.

Por que o modelo multimodal é um marco

O Gemini Embedding 2 marca um novo padrão de performance e versatilidade. Ele permite que uma única infraestrutura entenda texto, som e imagem de forma integrada, otimizando desde mecanismos de busca inteligentes até ferramentas de análise de sentimento multimodal.

Disponibilidade e primeiros usuários do Gemini Embedding 2

O modelo está disponível em versão pública desde março de 2026. Parcerias iniciais com desenvolvedores e empresas na área de análise de mídia e gestão de dados já demonstraram seu potencial para uso em sistemas RAG, motores de busca semântica e gestão de documentos corporativos. A integração direta com o Gemini API permite que desenvolvedores implementem suas soluções via notebooks interativos no Google Colab.

Impacto na jornada da inteligência artificial

Mais do que um lançamento técnico, o Gemini Embedding 2 representa uma mudança estrutural na forma como a IA compreende o mundo. Ao permitir que diferentes tipos de informação convivam de maneira nativa, o modelo abre espaço para sistemas verdadeiramente contextuais, capazes de associar múltiplas camadas de significado entre linguagens e mídias.

O que é o Gemini Embedding 2?

É o primeiro modelo de incorporação nativamente multimodal da Google. Ele mapeia texto, imagem, áudio, vídeo e documentos em um único espaço vetorial, permitindo busca e classificação cruzadas entre diferentes mídias.

Como acessar o Gemini Embedding 2?

O acesso está disponível via Gemini API e Vertex AI. Desenvolvedores podem usar notebooks no Colab e integrações com LangChain, Weaviate e QDrant para construir aplicações baseadas em embeddings multimodais.

Qual o diferencial técnico do modelo?

Ele utiliza Matryoshka Representation Learning, que permite redimensionar os vetores para equilibrar qualidade e custo computacional, além de suportar entradas intercaladas de múltiplos tipos de mídia.

Considerações finais

Com o Gemini Embedding 2, a Google inaugura uma era na qual a compreensão semântica não está mais restrita a um único tipo de dado. Ao integrar linguagens, sons, imagens e textos em um único modelo, o ecossistema Gemini se consolida como base de referência para o desenvolvimento de experiências de IA verdadeiramente multimodais e contextuais.