GPT-5.4 mini e nano chegam à API da OpenAI

A OpenAI anunciou o lançamento do GPT-5.4 mini e do GPT-5.4 nano na API, ampliando a família GPT-5.4 com modelos mais rápidos, baratos e otimizados para coding copilots, automação orientada por captura de tela e sistemas multiagentes. A proposta é clara: reduzir latência e custo por token sem sacrificar desempenho em tarefas de programação, raciocínio estruturado e uso de ferramentas. Enquanto o GPT-5.4 mini já está disponível na API, no Codex e no ChatGPT, o GPT-5.4 nano é voltado especificamente para usuários da API que precisam de classificação, extração e suporte leve de código em grande escala.

Com esse movimento, a OpenAI posiciona os novos modelos como soluções de produção, e não apenas versões reduzidas de seu modelo principal. A empresa destaca que o tempo de resposta molda o produto final — especialmente em ambientes com alto volume de requisições — e que o GPT-5.4 mini e o GPT-5.4 nano foram projetados exatamente para esses cenários.

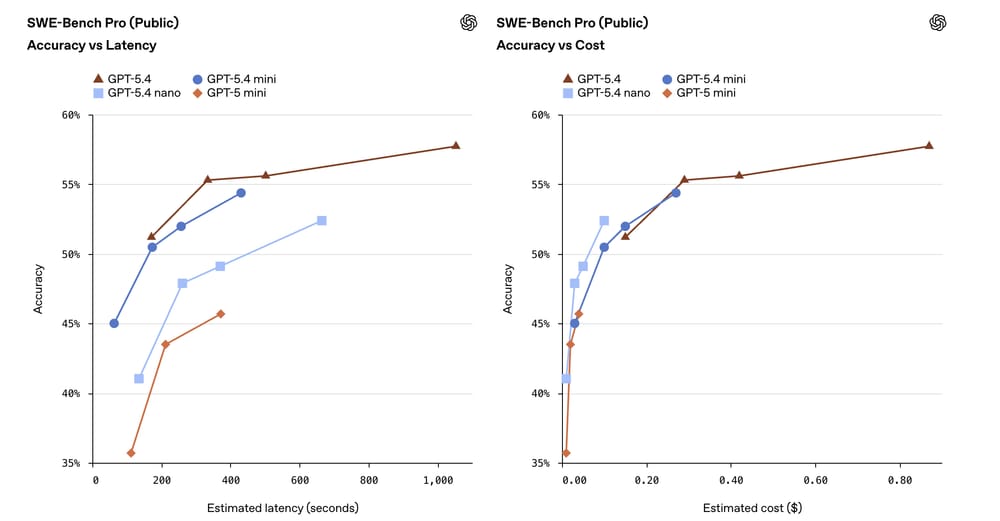

Desempenho: mais velocidade e benchmarks competitivos

Segundo a OpenAI, o GPT-5.4 mini é mais de duas vezes mais rápido que o GPT-5 mini, reduzindo significativamente a latência em aplicações críticas. Em benchmarks amplamente utilizados pela comunidade de desenvolvimento, os números chamam atenção. No SWE-Bench Pro, referência para avaliação de desempenho em tarefas reais de engenharia de software, o GPT-5.4 mini alcançou 54,4%, superando os 45,7% do GPT-5 mini.

Já no OSWorld-Verified, que mede a capacidade de agentes executarem tarefas operacionais verificadas em ambientes de sistema, o GPT-5.4 mini atingiu 72,1%, contra 42,0% do GPT-5 mini. Esses resultados aproximam o mini do desempenho do GPT-5.4 completo em tarefas de código e agentes, mantendo um custo inferior.

O GPT-5.4 nano, embora posicionado abaixo na hierarquia, também apresentou ganhos. Ele superou o GPT-5 mini em testes como SWE-Bench Pro e Toolathlon, mantendo a mesma janela de contexto de 400 mil tokens e saída máxima de 128 mil tokens — especificações idênticas às do mini. Isso o torna uma alternativa viável para classificação em larga escala, extração de dados estruturados, ranking de informações e automações leves.

Multimodalidade, agentes e uso de ferramentas

Tanto o GPT-5.4 mini quanto o GPT-5.4 nano aceitam entradas em texto e imagem, suportam saídas estruturadas e chamadas de função (function calling). Esses recursos são essenciais para arquiteturas modernas baseadas em agentes, nas quais o planejamento e a execução são divididos entre múltiplos subagentes especializados.

Na prática, isso significa que empresas podem utilizar o GPT-5.4 mini para coordenar fluxos mais complexos — como revisão de código, navegação por repositórios e análise de arquivos — enquanto o GPT-5.4 nano executa tarefas menores, como classificação de tickets, extração de campos em documentos ou roteamento de solicitações.

Preços: foco em custo por milhão de tokens

O lançamento ganha ainda mais relevância quando analisado sob a ótica de custo. O GPT-5.4 mini custa US$ 0,75 por milhão de tokens de entrada e US$ 4,50 por milhão de tokens de saída. Já o GPT-5.4 nano tem preço ainda mais agressivo: US$ 0,20 por milhão de tokens de entrada e US$ 1,25 por milhão de tokens de saída.

No Codex, o GPT-5.4 mini consome apenas 30% da cota do GPT-5.4, permitindo que desenvolvedores utilizem subagentes mais baratos para tarefas específicas, como busca em base de código e revisão automatizada. No ChatGPT, o modelo mini está disponível para usuários Free e Go por meio da opção “Thinking”, enquanto usuários de planos superiores o veem principalmente como fallback do GPT-5.4 Thinking.

Integração com Microsoft Foundry e estratégia de plataforma

A Microsoft rapidamente disponibilizou o GPT-5.4 mini e o GPT-5.4 nano no Foundry, inicialmente na Data Zone US, com a Data Zone EU prevista para breve. O movimento reforça a integração estratégica entre OpenAI e Microsoft, especialmente para clientes corporativos que demandam baixa latência, governança de dados e implantação regional.

Além disso, a OpenAI confirmou que o GPT-5.4 substitui oficialmente o GPT-5.2 na API e o GPT-5.3-Codex dentro do Codex. O mini e o nano não fragmentam a linha — eles expandem a pilha. A lógica é clara: o modelo principal planeja e resolve problemas complexos; os modelos menores executam tarefas específicas com eficiência operacional.

Casos reais e feedback inicial

Empresas como a Hebbia relataram que o GPT-5.4 mini igualou ou superou modelos concorrentes em tarefas de geração de saídas e recuperação de citações, com custo inferior. Já a Microsoft posiciona os novos modelos como camada de baixa latência para agentes de produção que precisam recuperar informações, roteá-las e agir quase em tempo real.

Esses relatos reforçam a estratégia da OpenAI de atender diferentes camadas de complexidade dentro de uma mesma arquitetura. Em vez de depender exclusivamente de um modelo grande para tudo, as empresas podem orquestrar múltiplos modelos GPT-5.4 conforme a criticidade e o volume de cada tarefa.

O que muda para desenvolvedores e empresas

Para desenvolvedores independentes, o GPT-5.4 mini representa uma combinação atraente de desempenho e custo, especialmente em aplicações SaaS que exigem respostas rápidas. Já o GPT-5.4 nano pode viabilizar produtos baseados em IA com margens mais sustentáveis, graças ao preço reduzido por token.

No contexto corporativo, a janela de contexto de 400 mil tokens abre espaço para análise de grandes bases documentais, contratos extensos e repositórios inteiros de código. A saída máxima de 128 mil tokens também permite gerar relatórios detalhados e respostas estruturadas complexas sem fragmentação excessiva.

Perguntas frequentes

O que é o GPT-5.4 mini?

É um modelo da família GPT-5.4 otimizado para velocidade e custo, disponível na API, Codex e ChatGPT, com foco em programação, agentes e multimodalidade.

Qual a diferença entre GPT-5.4 mini e GPT-5.4 nano?

O mini oferece desempenho mais próximo do GPT-5.4 completo, enquanto o nano prioriza custo mínimo para tarefas como classificação, extração e automações leves via API.

Qual é o preço dos novos modelos?

O GPT-5.4 mini custa US$ 0,75 por milhão de tokens de entrada e US$ 4,50 por milhão de tokens de saída. O GPT-5.4 nano custa US$ 0,20 e US$ 1,25, respectivamente.

Os modelos aceitam imagens?

Sim. Tanto o GPT-5.4 mini quanto o nano suportam entradas multimodais (texto e imagem), além de chamadas de função e saídas estruturadas.

Onde estão disponíveis?

O GPT-5.4 mini está na API, no Codex e no ChatGPT. O GPT-5.4 nano está disponível via API e também integrado ao Microsoft Foundry.

Considerações finais

Com o lançamento do GPT-5.4 mini e do GPT-5.4 nano, a OpenAI reforça sua estratégia de segmentação por desempenho e custo dentro da mesma arquitetura. Ao combinar alta janela de contexto, multimodalidade e preços competitivos, os novos modelos ampliam as possibilidades para coding copilots, agentes autônomos e sistemas de automação em larga escala. A tendência é que arquiteturas multiagentes se tornem padrão, utilizando o GPT-5.4 como cérebro principal e as versões mini e nano como motores de execução eficientes. Para o ecossistema de IA, trata-se de um passo significativo rumo a aplicações mais rápidas, escaláveis e economicamente viáveis.