Cursor apresenta o CursorBench-3 para testar agentes de código

A plataforma Cursor AI anunciou oficialmente o CursorBench-3, uma nova suíte interna de avaliação projetada para medir o desempenho real de agentes de codificação em tarefas de desenvolvimento complexas e multiarquivos. Este lançamento representa um avanço significativo na forma como os modelos de IA são medidos quando aplicados a ambientes de programação do mundo real, trazendo métricas de eficiência, correção e comportamento diretamente das interações reais de desenvolvedores com a ferramenta.

Tabela de conteúdos

O que é o CursorBench-3 e por que ele importa

O CursorBench-3 é descrito como um benchmark interno desenvolvido pela equipe de engenharia da Cursor para testar agentes que auxiliam programadores em seus fluxos de trabalho. Diferente de benchmarks públicos amplamente utilizados — como o HumanEval —, esta nova suíte de avaliação foca em projetos multi-arquivo, monorepositórios e solicitações ambíguas, muito mais próximas da realidade dos desafios enfrentados pelos desenvolvedores. Essa abordagem torna a avaliação dos agentes mais fiel à experiência de uso prática.

“Estamos compartilhando um novo método para pontuar modelos em tarefas de codificação orientadas por agentes.”

Conta oficial do Cursor no X (antigo Twitter), 12 de março de 2026

De acordo com a empresa, o benchmarking é atualizado regularmente por meio de uma ferramenta chamada Cursor Blame, que alimenta o conjunto de testes com problemas reais resolvidos na plataforma. Essa estratégia reduz o risco de contaminação de dados de treinamento e mantém o benchmark alinhado com a realidade em constante mudança das práticas de desenvolvimento modernas.

Benckmark interno e impacto em produtos da Cursor

O CursorBench-3 é atualmente uma ferramenta restrita às equipes internas de engenharia e pesquisa da Cursor. Os resultados obtidos nos testes são utilizados diretamente para aprimorar os modelos de IA e guiar atualizações de produto que melhoram a experiência de desenvolvedores que dependem da plataforma no dia a dia. Essa integração contínua entre pesquisa e aplicação prática fortalece o compromisso da empresa em oferecer uma ferramenta de apoio ao código alinhada aos padrões de qualidade e produtividade esperados por desenvolvedores profissionais.

Entre os critérios analisados pelo benchmark estão:

- Correção das soluções geradas pelos agentes;

- Eficiência computacional e estrutural do código produzido;

- Comportamento de interação entre agente e desenvolvedor;

- Qualidade generalizada das respostas e sugestões geradas.

Diferenciais da abordagem Cursor

O principal diferencial da Cursor AI com o CursorBench-3 está na conexão direta entre avaliação e produto. A maioria dos benchmarks públicos mede modelos de forma estática, isolados do uso real. No entanto, o CursorBench-3 coleta e analisa dados de sessões reais de desenvolvimento, permitindo que as melhorias nos modelos sejam baseadas em evidências de uso prático.

Além disso, a equipe da Cursor complementa as análises automatizadas com experimentos online controlados, comparando os resultados de benchmarks a níveis de satisfação genuína de desenvolvedores. Isso ajuda a identificar lacunas que avaliações puramente técnicas não captam, resultando em um refinamento contínuo dos agentes de código.

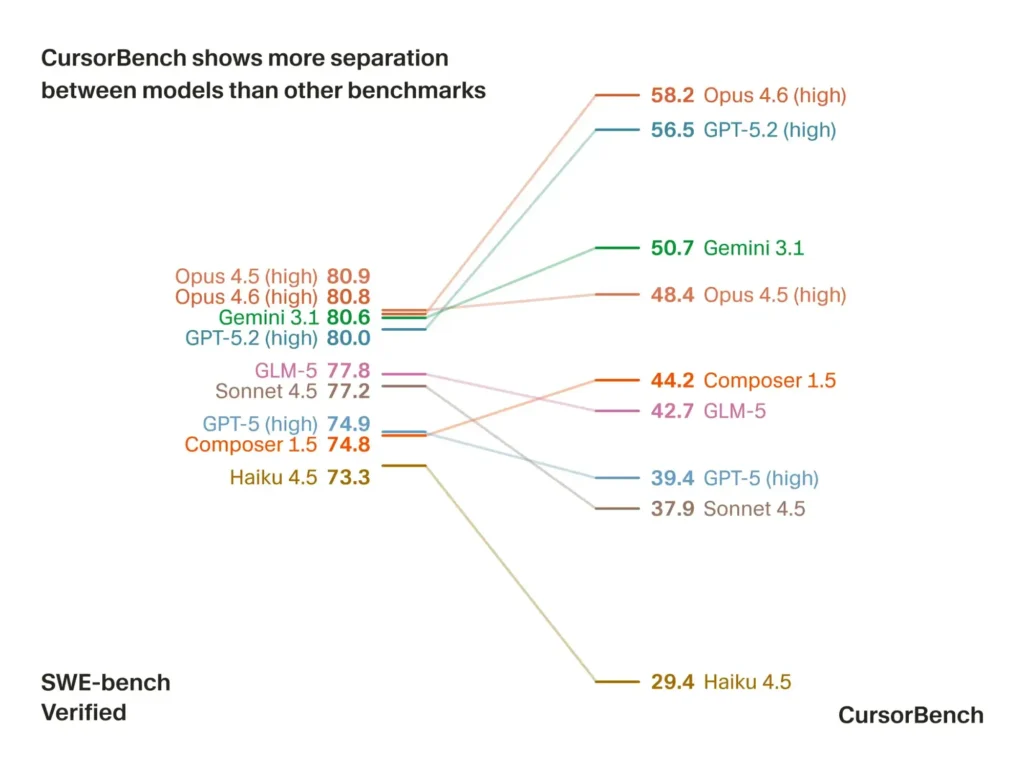

Comparação com benchmarks públicos

Benchmarks públicos como o HumanEval, MBPP ou CodeXGLUE têm sido amplamente utilizados para medir a capacidade dos modelos linguísticos em programar. Contudo, segundo a Cursor, eles apresentam limitações importantes quando aplicados a cenários mais amplos e integrados, como projetos repletos de dependências, revisão de código em equipe ou sistemas legados.

O CursorBench-3 se propõe a superar essas limitações ao incorporar tarefas dinâmicas, baseadas em casos reais e expandidos, nos quais o modelo precisa entender contexto de múltiplos arquivos e se adaptar a mudanças em tempo real — algo muito mais próximo do que acontece em ambientes corporativos modernos.

Visão estratégica e próximos passos

Esta versão marca um passo estratégico da Cursor na construção de um ecossistema de agentes de IA autônomos e integrados. Com o crescimento de ferramentas concorrentes como GitHub Copilot, Claude Code Review e Gemini Code Assist, a empresa aposta em métricas mais fiéis à realidade do desenvolvedor profissional. Ao focar em projetos vivos e situações de uso orgânicas, a Cursor busca manter seus modelos na vanguarda de qualidade e aplicabilidade prática.

O lançamento reforça também a importância de benchmarks personalizados em um momento em que o mercado de IA aplicada à programação cresce em ritmo acelerado. As equipes que desejam adotar soluções de IA mais confiáveis devem considerar o impacto de benchmarks como o CursorBench-3 na qualidade final dos modelos empregados.

O que é o CursorBench-3?

O CursorBench-3 é uma suíte de avaliação interna criada pela Cursor AI para medir o desempenho e a eficiência de agentes de codificação em tarefas reais de desenvolvimento. Ele inclui métricas sobre correção, qualidade e comportamento dos modelos.

Como o CursorBench-3 difere de benchmarks públicos?

Enquanto benchmarks públicos utilizam problemas estáticos e pequenos, o CursorBench-3 avalia agentes em projetos vivos, multi-arquivo e de larga escala. Isso reflete melhor os desafios enfrentados pelos desenvolvedores modernos.

Quem pode acessar o CursorBench-3?

Atualmente, o CursorBench-3 é restrito às equipes internas de pesquisa e engenharia da Cursor. Os resultados são usados para aprimorar modelos e oferecer melhores produtos aos usuários da plataforma.

Por que benchmarks internos são importantes?

Benchmarks internos ajudam empresas como a Cursor a refinar seus modelos com base em uso real. Isso aumenta a confiabilidade dos resultados e gera melhorias mais alinhadas às necessidades práticas dos desenvolvedores.

Considerações finais

Ao lançar o CursorBench-3, a Cursor reafirma sua posição como uma das líderes em inovação no campo da programação assistida por IA. O novo benchmark não apenas oferece um método mais avançado de medir o desempenho de agentes de código, mas também redefine as expectativas do mercado em relação à forma como a inteligência artificial pode se integrar de maneira eficiente e produtiva aos ambientes de desenvolvimento profissional.