Perplexity lança modelos de embedding de alta performance

A Perplexity anunciou o lançamento de dois novos modelos de embedding, pplx-embed-v1 e pplx-embed-context-v1. Desenvolvidos para tarefas de recuperação em larga escala (large-scale retrieval), esses modelos oferecem desempenho de ponta e otimização de armazenamento. A novidade marca um avanço importante na linha de produtos da empresa, focada em soluções de busca semântica e geração aumentada por recuperação (Retrieval-Augmented Generation – RAG).

Tabela de conteúdos

Os modelos foram apresentados em 27 de fevereiro de 2026 e já estão disponíveis publicamente sob licença MIT, tanto via Hugging Face quanto pela API oficial da Perplexity. Com versões de 0.6 bilhões e 4 bilhões de parâmetros, a linha pplx-embed foi criada para equilibrar velocidade, eficiência e qualidade de resultados.

Quantização e eficiência em escala

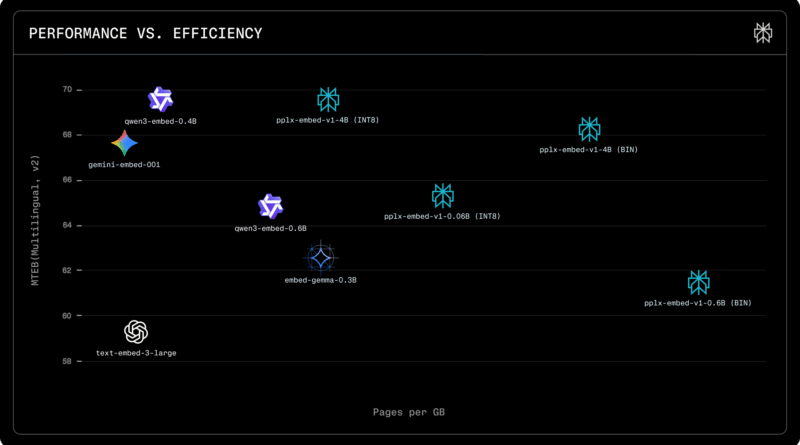

Uma das grandes inovações é o uso nativo de quantização INT8 e binária, o que reduz o tamanho dos modelos em até 32 vezes quando comparados ao padrão FP32. Isso significa menor custo de armazenamento e maior velocidade de execução, um diferencial crucial para empresas que lidam com volumes massivos de dados. Segundo a Perplexity, o modelo de 4B parâmetros mantém níveis de precisão comparáveis aos principais concorrentes, mesmo sob compressão pesada.

De acordo com a publicação oficial no Twitter, os novos modelos foram pensados para uso em recuperação de informações de escala web, um dos cenários mais complexos da inteligência artificial moderna. Ao eliminar a necessidade de prefixes de instrução, o pplx-embed evita erros frequentes em implantações do mundo real.

Desempenho superior em benchmarks

Os resultados preliminares apontam que os modelos da Perplexity superam concorrentes como Qwen3-Embedding e Gemini-Embedding em testes de busca contextual e multilíngue. O modelo pplx-embed-context-v1, em especial, apresentou ganhos consistentes em tarefas que envolvem contextualização de documentos longos, fator determinante para aplicações em sistemas de recomendação e chatbots baseados em conhecimento.

Essa superioridade é resultado de um pipeline de treinamento em múltiplas fases, que inclui pré-treinamento por difusão e aprendizado contrastivo. Com isso, os embeddings se tornam mais “cientes” do contexto, capturando nuances linguísticas e semânticas com maior precisão. Esse tipo de arquitetura é fundamental para sistemas que utilizam Retrieval-Augmented Generation (RAG) em larga escala.

Aplicações práticas e acessibilidade

Os novos modelos podem ser integrados a frameworks populares como Transformers, SentenceTransformers e ONNX. Isso significa que desenvolvedores e pesquisadores poderão aplicá-los em pipelines de busca semântica, classificação de texto, recomendação de conteúdo e mecanismos de geração contextualizada.

Enquanto o pplx-embed-v1 é otimizado para velocidade e baixo consumo de recursos, o pplx-embed-context-v1 foca na profundidade semântica, oferecendo precisão ampliada em ambientes multilíngues e contextuais. Essa diferenciação permite que empresas escolham o modelo ideal conforme suas necessidades de operação — seja priorizando rapidez ou qualidade de resultados.

Repercussões no mercado de IA

Especialistas do setor destacam que a Perplexity tem se consolidado como uma força relevante em recuperação de informações. Ao contrário de gigantes como Google e Anthropic, a empresa adota uma estratégia verticalizada, concentrando-se em soluções otimizadas para sistemas de busca e indexação. O lançamento dos embeddings pplx-embed posiciona a Perplexity entre os principais fornecedores de tecnologia de embeddings do mundo, especialmente no nicho de acesso escalável a informações.

Contexto técnico e comparativo

| Modelo | Tamanho | Quantização | Foco |

|---|---|---|---|

| pplx-embed-v1 | 0.6B | INT8 | Eficiência e velocidade |

| pplx-embed-context-v1 | 4B | Binária | Precisão e contexto |

Os modelos utilizaram técnicas de otimização de quantização avançadas, permitindo o uso eficiente de hardware moderno, desde GPUs até processadores otimizados para operações vetoriais. Essa arquitetura também amplia a aplicabilidade em dispositivos de borda, um território ainda pouco explorado por modelos de grande capacidade.

Disponibilidade e licença aberta

Ambos os modelos estão licenciados sob MIT License, o que reduz barreiras de adoção e incentiva a comunidade de código aberto a integrá-los em projetos existentes. A disponibilização no Hugging Face também possibilita experimentação rápida para pesquisadores interessados em entender seu comportamento em tarefas de busca semântica e classificação textual.

A documentação técnica detalhada pode ser acessada no artigo científico da Perplexity Research, que descreve a arquitetura, benchmarks e metodologia de avaliação dos novos embeddings.

Perguntas frequentes sobre modelos de embedding no Perplexity

O que são os modelos pplx-embed?

São modelos de embedding desenvolvidos pela Perplexity para recuperação de informações em larga escala. Eles convertem textos em vetores com alta eficiência semântica utilizando quantização avançada.

Qual a diferença entre o pplx-embed-v1 e o pplx-embed-context-v1?

O pplx-embed-v1 é otimizado para velocidade e economia de recursos, enquanto o pplx-embed-context-v1 prioriza qualidade e profundidade semântica, indicado para contextos complexos e multilíngues.

Posso usar esses modelos gratuitamente?

Sim, ambos estão disponíveis sob licença MIT e podem ser acessados via API da Perplexity ou pela plataforma Hugging Face sem custos de licenciamento.

Os modelos podem ser aplicados em RAG (Retrieval-Augmented Generation)?

Sim. Os embeddings foram projetados para uso direto em pipelines de RAG, permitindo busca contextual e geração de respostas aprimoradas com base em consultas semânticas.

Considerações finais

Com o lançamento dos pplx-embed-v1 e pplx-embed-context-v1, a Perplexity reforça sua posição como uma das principais referências em tecnologia de embeddings. A combinação de eficiência computacional, licença aberta e foco em escalabilidade consolida uma base sólida para futuras aplicações em IA de busca e recomendação. Esses modelos prometem redefinir o padrão de desempenho para recuperação de informações em larga escala, abrindo caminho para novas experiências de pesquisa e interação com o conhecimento digital.