DeepSeek V4 desafia GPT‑5 e Gemini com IA mais acessível

A DeepSeek, um dos laboratórios chineses mais promissores de inteligência artificial, apresentou oficialmente as versões de prévia de seus novos modelos de linguagem de grande porte DeepSeek V4 Flash e V4 Pro. A empresa afirma que as melhorias arquiteturais dessas versões elevaram a eficiência e o desempenho a ponto de quase “fechar a lacuna” em relação aos modelos de ponta como o GPT‑5.4 da OpenAI e o Gemini 3.1 Pro do Google.

Tabela de conteúdos

Arquitetura e parâmetros do DeepSeek V4

Os dois novos modelos são do tipo mixture‑of‑experts, uma técnica em que apenas uma parte dos parâmetros é ativada a cada solicitação, reduzindo custos de inferência e otimizando a eficiência. Ambos contam com uma janela de contexto de 1 milhão de tokens, permitindo lidar com enormes bases de código e documentos extensos em um único prompt.

O V4 Pro possui 1,6 trilhão de parâmetros, sendo 49 bilhões ativos por tarefa — o que o torna o maior modelo de código aberto disponível até o momento. Ele supera concorrentes como o Kimi K 2.6 da Moonshot AI e o M1 da MiniMax, e tem mais do que o dobro do DeepSeek V3.2. O V4 Flash, menor, conta com 284 bilhões de parâmetros, com 13 bilhões ativos.

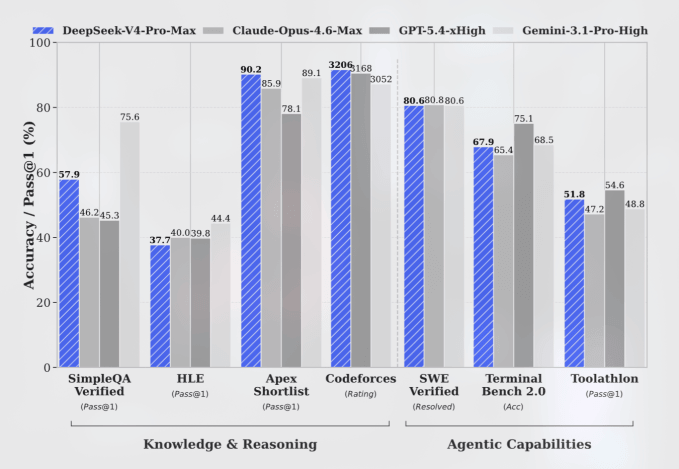

Desempenho e comparativos com modelos de ponta

Segundo a empresa, o DeepSeek V4‑Pro‑Max supera outros modelos de código aberto em testes de raciocínio e chega a ultrapassar o GPT‑5.2 e o Gemini 3.0 Pro em várias tarefas complexas. Em benchmarks de programação, o desempenho dos modelos V4 é “comparável ao GPT‑5.4”, uma conquista expressiva considerando os custos mais baixos e a natureza open source da DeepSeek.

Entretanto, os modelos ainda ficam um pouco atrás em testes de conhecimento factual, especialmente quando comparados a sistemas de ponta de OpenAI e Google, como GPT‑5.4 e Gemini 3.1 Pro. A DeepSeek reconhece uma diferença técnica equivalente a um atraso de desenvolvimento de cerca de três a seis meses em relação às soluções consideradas state‑of‑the‑art.

Vantagem de custo e acessibilidade

Um dos grandes diferenciais do V4 está no custo operacional. O V4 Flash custa apenas US$ 0,14 por milhão de tokens de entrada e US$ 0,28 por milhão de tokens de saída, superando em preço os planos de entrada de grandes concorrentes como GPT‑5.4 Nano e Claude Haiku 4.5. Já o V4 Pro cobra US$ 0,145 por milhão de tokens de entrada e US$ 3,48 por milhão de saída — um custo ainda inferior ao Gemini 3.1 Pro e GPT‑5.5.

Limitações atuais e foco textual

Os dois modelos da DeepSeek ainda oferecem suporte exclusivamente a texto. Diferentemente de sistemas fechados da OpenAI e do Google, eles não geram ou interpretam imagens, áudio ou vídeo. Essa limitação, contudo, é temporária — a empresa já sinalizou o desenvolvimento de um modelo multimodal para 2027.

Polêmicas envolvendo propriedade intelectual

O lançamento ocorre em meio a novas acusações do governo dos EUA de que laboratórios chineses estariam roubando propriedade intelectual americana em larga escala, usando milhares de contas falsas. A própria DeepSeek já foi acusada pela Anthropic e pela OpenAI de realizar práticas de “distillation”, copiando ou replicando características de modelos concorrentes a partir de amostras públicas e interações observadas.

O que é distillation em IA?

O termo distillation descreve o processo de replicar comportamentos de modelos avançados por meio de extração indireta de respostas. Embora eficiente para acelerar avanços open source, essa prática levanta debates éticos e legais sobre direitos autorais de algoritmos e dados de treinamento.

Perspectivas e próximos passos

Com a chegada do DeepSeek V4, o ambiente global de IA open source se torna ainda mais competitivo. Especialistas apontam que o custo acessível e a transparência da DeepSeek podem pressionar players ocidentais a abrir parte de seus códigos ou reduzir preços.

Segundo o analista Xu Wei, da consultoria AIAsia, “a DeepSeek está se posicionando como o OpenAI da China — com um modelo de negócios híbrido que combina abertura, eficiência e custos calculados para escala global”.

Perguntas Frequentes sobre DeepSeek V4 e o futuro da IA

O que diferencia o DeepSeek V4 dos modelos GPT‑5 e Gemini?

O DeepSeek V4 usa uma arquitetura mixture‑of‑experts que ativa apenas parte dos parâmetros em cada consulta, tornando‑o mais eficiente e econômico. Enquanto o GPT‑5 e o Gemini 3.1 Pro são modelos multimodais, o V4 foca no processamento textual com contexto estendido de até 1 milhão de tokens.

O DeepSeek V4 é realmente open source?

Sim, as versões V4 Flash e V4 Pro são open‑weight, permitindo acesso e modificação da arquitetura por pesquisadores e desenvolvedores. Essa abordagem amplia a colaboração global e acelera inovações na área de IA.

Qual é o custo de uso do DeepSeek V4?

O V4 Flash custa US$ 0,14 por milhão de tokens de entrada e US$ 0,28 por milhão de saída. O V4 Pro tem custo de US$ 0,145 por milhão de entrada e US$ 3,48 por milhão de saída — valores bem inferiores às opções comerciais equivalentes de OpenAI e Google.

O DeepSeek V4 já supera o GPT‑5?

Em alguns benchmarks de raciocínio e codificação, o V4 Pro‑Max se equipara ou supera versões como GPT‑5.2, mas ainda fica atrás em testes de conhecimento e compreensão multimodal. É considerado cerca de 3 a 6 meses atrás dos frontier models.

Quando chegará a versão multimodal do DeepSeek?

Segundo declarações recentes da própria empresa, o modelo multimodal — capaz de compreender áudio, vídeo e imagens — deve ser anunciado até o fim de 2027.

Considerações finais

Com o lançamento do DeepSeek V4, a China reafirma seu papel central no ecossistema global de inteligência artificial. O modelo combina eficiência técnica, custo acessível e abertura de código, aproximando ainda mais a fronteira entre inovação independente e modelos corporativos fechados. Resta saber se a DeepSeek conseguirá sustentar essa vantagem e se livrar das polêmicas de propriedade intelectual que marcam a corrida global pela supremacia da IA.