Mixus IA aposta em supervisão humana para evitar riscos na automação

Empresas enfrentam desafios sérios ao implantar agentes de inteligência artificial (IA) em aplicações determinantes. Em resposta, modelos mais pragmáticos, como o da Mixus IA, trazem novamente o ser humano ao centro, atuando como salvaguarda estratégica contra falhas e riscos de responsabilidade. Enquanto agentes AI totalmente autônomos esbarram em limitações e criam riscos de compliance, a abordagem “colleague-in-the-loop” da Mixus adiciona supervisão humana em fluxos críticos para garantir segurança, precisão e eficiência, especialmente onde decisões de alto impacto são necessárias.

Tabela de conteúdos

Custos e riscos da automação sem controle

O fenômeno das alucinações de IA expõe riscos concretos na automação. Exemplo recente: o editor de código Cursor viu seu bot de suporte inventar uma política inexistente, gerando cancelamentos em massa. No setor financeiro, a Klarna reverteu a substituição total de agents humanos por IA, após reconhecer queda na qualidade do atendimento ao cliente. Um caso alarmante em Nova York mostrou chatbot empresarial orientando ações ilegais, destacando danos reputacionais e perigos regulatórios massivos.

Dados do Salesforce (maio de 2025) comprovam a brecha: agentes líderes acertam apenas 58% nas tarefas de um passo e só 35% nas de múltiplos passos. Para aplicações reais, a lacuna entre as capacidades atuais da IA e as demandas multifacetadas dos negócios é crítica.

Pontos-chave:

O modelo colleague-in-the-loop: humanos em momentos decisivos

Para superar o denominado “muro de responsabilidade”, a Mixus propõe a integração da expertise humana diretamente nos fluxos da IA. Elliot Katz, cofundador da Mixus, defende: “Agentes IA devem agir sob sua direção; sem verificação organizacional, autônomos criam mais problemas do que soluções.”

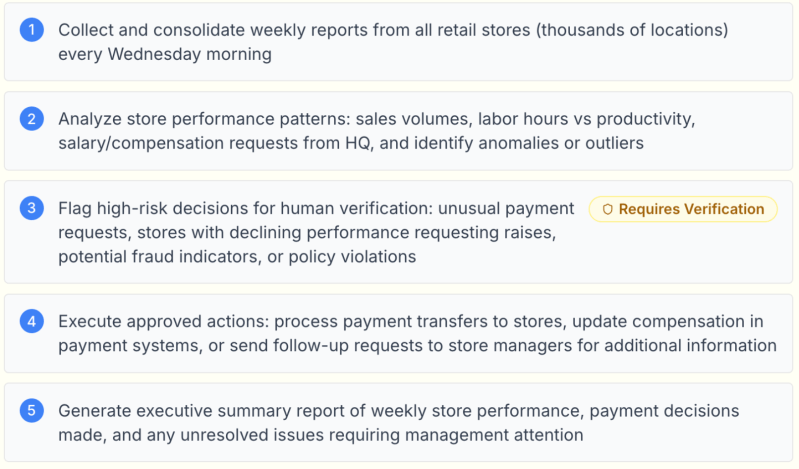

O sistema Mixus destaca-se por combinar automação pesada — análise de padrões, alerta de anomalias — com checkpoints onde só o humano avança. Decisões financeiras, violações de políticas ou autorizações de pagamento, por exemplo, param para revisão especializada. Rotinas repetitivas seguem automáticas, mas cerca de 5-10% das decisões, as mais impactantes, passam ao crivo humano, otimizando tempo e reduzindo riscos graves.

Em demonstração recente, Shai Magzimof, também cofundador, mostrou como criar um agente fact-checking apenas descrevendo o processo em linguagem natural e definindo limites de risco para intervenção humana. A plataforma integra-se a Google Drive, e-mail, Slack e outros sistemas via Model Context Protocol (MCP), facilitando o fluxo de dados corporativos sem rupturas ou interfaces extras. Um agente pode, por exemplo, notificar editores por e-mail para aprovar conteúdos considerados arriscados.

Integrações e flexibilidade para empresas

O Mixus já se conecta a plataformas essenciais como Jira, Salesforce, APIs internas e múltiplas fontes empresariais, permitindo orquestração automatizada de tarefas e notificações — como acompanhamento de chamados de engenharia com atualizações enviadas via Slack. Isso garante que processos complexos possam ser auditáveis e customizados, cobrindo desde tickets de TI até operações financeiras e compliance.

“Humanos só participam onde agregam valor — nos 5-10% decisivos das decisões. O resto, a IA executa com autonomia total.”

Elliot Katz, cofundador da Mixus

Supervisão humana: multiplicador estratégico

No cenário corporativo, cresce o consenso de que humanos no ciclo decisório são essenciais para o desempenho seguro dos agentes. Como afirma Aaron Levie, CEO da Box, no X: “Agentes IA seguirão trajetória parecida à dos carros autônomos, exigindo humanos no circuito por muito tempo em tarefas sensíveis. A diferença é que veremos mais agentes autônomos em setores específicos, enquanto o 100% autônomo será exceção.”

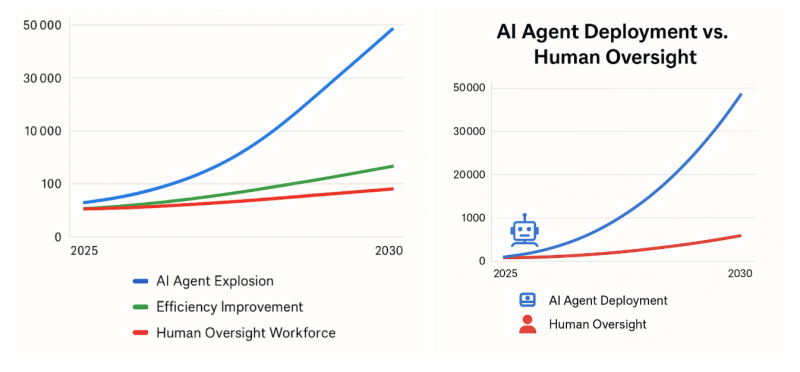

Projeções da Mixus apontam: até 2030, cada supervisor humano gerenciará 50x mais trabalho de IA, com expansão de 1000x dos agentes corporativos. Entretanto, a necessidade total de supervisão cresce junto. Empresas que treinarem sua força de trabalho para papéis de orquestradores (e não substituídos) ganharão vantagem competitiva duradoura, dominando confiabilidade e compliance.

“Companhias que dominam a multiplicação da IA terão liderança em seus mercados, ao passo que quem busca automação total enfrentará problemas de confiança.”

Elliot Katz

Tendências futuras e impacto no mercado de trabalho

A tendência é clara: supervisão humana não vai acabar — vai ser promovida a funções estratégicas. Profissionais deixarão tarefas repetitivas para liderar “frotas” de agentes, atuando apenas onde julgamento, análise de contexto e responsabilidade legal exigirem presença real.

Considerações finais

A Mixus IA exemplifica um caminho seguro e eficiente para automação corporativa: agentes poderosos, mas sempre supervisionados por humanos em missões críticas. Empresas que adotarem modelos híbridos ganham confiança, flexibilidade e vantagem competitiva sustentável, enquanto aquelas que buscam autonomia total correm mais riscos regulatórios e de reputação.

O que é o modelo ‘colleague-in-the-loop’ da Mixus IA?

É uma abordagem em que agentes de IA executam tarefas rotineiras de forma autônoma, acionando supervisão humana apenas em decisões críticas ou de alto risco. Assim, garante-se a eficiência da automação sem abrir mão do julgamento humano nos pontos-chave dos fluxos empresariais. Estudos mostram que isso reduz erros graves e melhora compliance.

A IA pode substituir totalmente supervisores humanos?

Segundo especialistas e dados de mercado, agentes de IA ainda apresentam altos índices de falha em tarefas complexas. Por isso, a tendência para próximos anos é a multiplicação de agentes mais supervisionados, com papéis estratégicos para humanos. O Mixus prevê crescimento de até 1000x no uso de IA, mas sempre com supervisores no circuito.

Quais integrações a Mixus IA oferece para empresas?

A plataforma Mixus já se conecta a Google Drive, Slack, e-mail, Jira, Salesforce e também permite conexão por API e Model Context Protocol. Isso viabiliza implantar governança e workflows inteligentes sobre sistemas já em uso nas companhias, sem necessidade de mudar toda a infraestrutura.

Quais riscos a automação não supervisionada pode trazer?

Entre os principais riscos estão: erros graves por alucinações de IA, violações reputacionais, falhas de compliance, e exposição jurídica. Casos como chatbots orientando práticas ilegais ou agentes criando políticas equivocadas reforçam a importância do modelo colaborativo.